20.5 Mitigasi Risiko Enterprise AI: Kebocoran Data, Jawaban Tanpa Dasar, dan Akses Melewati Batas

Semakin banyak cara kerja yang terintegrasi, semakin penting mitigasi risiko enterprise AI. Bayangkan skenario ini: seorang staf HR membuka basis pengetahuan AI untuk mencari kebijakan cuti melahirkan. Ia mengetik pertanyaan, dan AI menjawab dengan lengkap—termasuk menyertakan data gaji karyawan lain yang seharusnya tidak bisa diakses olehnya. Atau bayangkan seorang agen support yang menerima keluhan pelanggan, lalu AI menyarankan solusi yang terdengar meyakinkan tetapi sebenarnya tidak pernah ada dalam kebijakan perusahaan. Dua situasi ini menggambarkan risiko yang muncul saat AI mulai menyentuh data dan keputusan nyata.

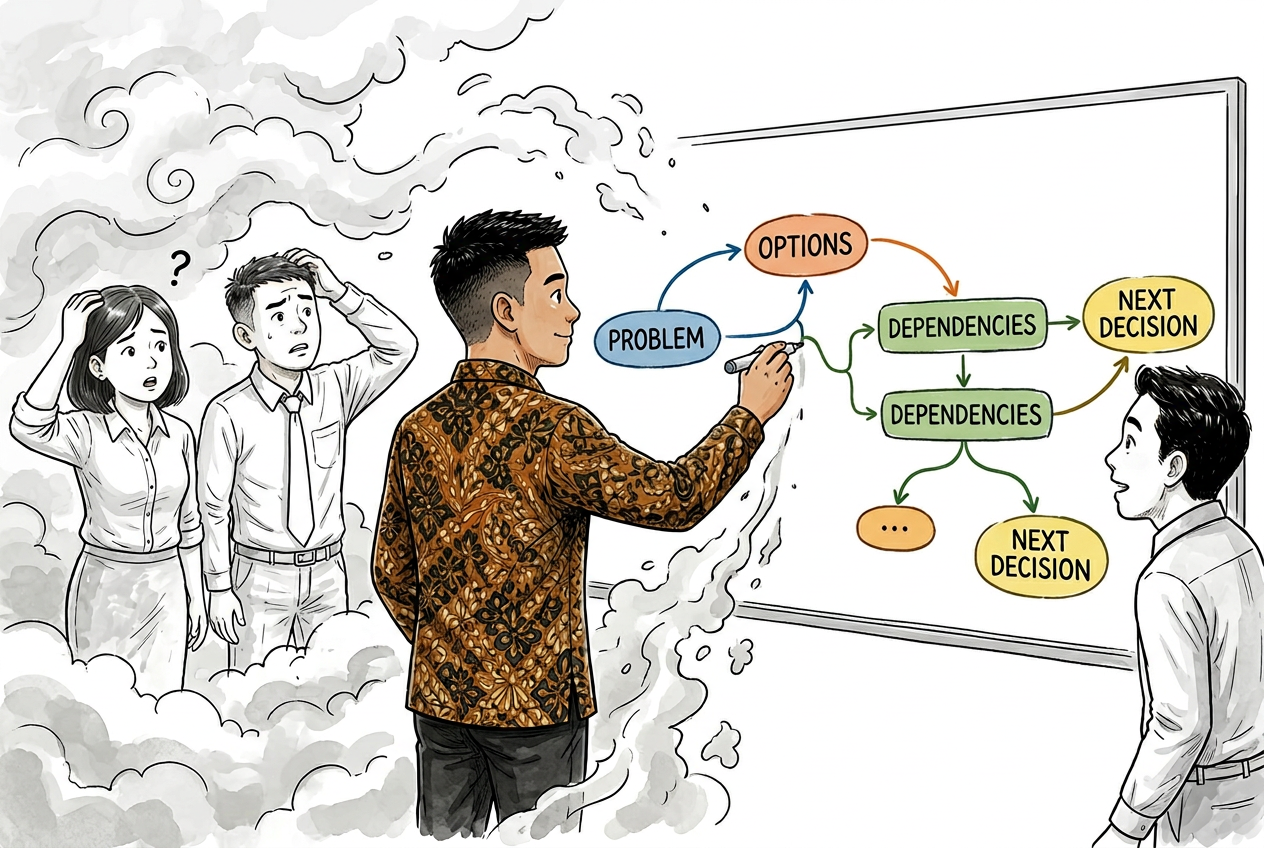

Diagram berikut memetakan tiga risiko utama enterprise AI beserta penyebab dan mitigasinya dalam satu alur dari input hingga output.

Risiko pertama adalah kebocoran data. Ketika AI diintegrasikan ke berbagai sistem perusahaan—ticketing, CRM, sistem pengelolaan dokumen, ERP—akses ke data menjadi lebih cair. Dokumen yang tadinya hanya bisa dibuka oleh tim legal tiba-tiba bisa muncul dalam jawaban AI untuk staf operasional. Ini bukan karena AI jahat, tetapi karena permission dan access control belum dipetakan dengan benar ke dalam arsitektur knowledge. Jika metadata akses tidak disertakan saat pemecahan dokumen, atau jika pencarian berbasis konteks tidak memfilter berdasarkan peran pengguna, maka data yang seharusnya terbatas bisa bocor melalui jawaban AI.

Berikut contoh konfigurasi YAML untuk mendefinisikan role-based access control pada knowledge base, memastikan dokumen hanya muncul untuk pengguna yang berhak.

# knowledge-base-access.yaml

# Mendefinisikan akses dokumen berdasarkan peran pengguna

roles:

- name: hr_staff

allowed_tags:

- hr_policy

- employee_benefits

denied_tags:

- legal_only

- finance_only

- name: legal_team

allowed_tags:

- legal_only

- hr_policy

- contract

- name: finance_team

allowed_tags:

- finance_only

- hr_policy

documents:

- id: doc-001

title: "Kebijakan Cuti Melahirkan"

tags: [hr_policy, employee_benefits]

access: [hr_staff, legal_team, finance_team]

- id: doc-002

title: "Data Gaji Karyawan 2025"

tags: [finance_only, legal_only]

access: [finance_team, legal_team]

- id: doc-003

title: "Kontrak Vendor Rahasia"

tags: [legal_only, contract]

access: [legal_team]

filter_rules:

- description: "Filter dokumen sebelum dikirim ke LLM"

action: "reject"

condition: "user.role not in document.access"

Konfigurasi ini memastikan staf HR tidak akan pernah menerima data gaji dalam jawaban AI, karena dokumen dengan tag finance_only atau legal_only akan difilter berdasarkan peran pengguna.

Risiko kedua adalah jawaban tanpa dasar. Ini bukan soal AI berbohong, tetapi soal AI menghasilkan jawaban yang terdengar benar tetapi tidak didukung oleh sumber. Dalam konteks enterprise, jawaban tanpa dasar berbahaya karena jawaban AI sering disampaikan dengan percaya diri. Seorang auditor mungkin menerima laporan compliance yang menyebutkan bahwa suatu prosedur sudah dijalankan, padahal tidak ada dokumen yang benar-benar membuktikannya. Atau seorang staf finance bisa mengambil keputusan pembayaran berdasarkan informasi yang tidak pernah ada dalam sistem. Mitigasi utamanya adalah penelusuran sumber: setiap jawaban harus bisa dilacak ke dokumen asli, dan ambang keyakinan harus ditetapkan sehingga AI tidak memberikan jawaban jika tidak yakin.

Risiko ketiga adalah akses melewati batas. Ini terjadi ketika AI memiliki akses ke lebih banyak data daripada yang seharusnya dimiliki oleh pengguna yang mengaksesnya. Misalnya, seorang staf procurement bertanya tentang vendor tertentu, dan AI mengambil data dari dokumen yang hanya boleh diakses oleh tim legal. Atau seorang agen support mendapatkan insight tentang strategi harga yang seharusnya hanya diketahui oleh tim product. Akses melewati batas sering terjadi karena arsitektur knowledge belum mempertimbangkan access control di level pencarian berbasis konteks, bukan hanya di level penyimpanan.

Selain tiga risiko utama itu, ada risiko lain yang perlu diwaspadai: pengetahuan usang. Dokumen yang sudah tidak berlaku bisa tetap muncul dalam jawaban AI jika tidak ada mekanisme freshness. Otomatisasi salah terjadi ketika AI mengambil tindakan otomatis—misalnya menyetujui refund atau mengubah status tiket—tanpa verifikasi manusia. Dan persetujuan manusia yang terlewat adalah risiko ketika cara kerja AI berjalan terlalu cepat sehingga keputusan yang seharusnya melewati review manusia terlewat.

Mitigasi risiko-risiko ini tidak bisa dilakukan dengan satu solusi. Diperlukan pendekatan berlapis: access control di level metadata, penelusuran sumber di setiap jawaban, ambang keyakinan untuk menentukan kapan AI boleh menjawab sendiri, dan persetujuan manusia untuk keputusan yang berisiko tinggi. Tanpa mitigasi ini, AI enterprise bukan alat bantu, melainkan sumber masalah baru.

Dari sini, kita perlu membahas bagaimana mengelola cara kerja AI dengan governance yang tepat—kapan harus percaya pada AI, kapan harus melibatkan manusia, dan bagaimana memastikan setiap keputusan bisa diaudit.